代码优化是软件工程中的关键任务,旨在自动重构代码以提高其执行效率。开发人员编写的代码常常存在效率问题和各种性能缺陷,这些低效之处使得代码优化的自动化方法研究变得尤为必要。传统的代码优化方法主要采用基于规则的策略,专注于特定的低效问题,但这些方法往往耗费人力且覆盖率有限。近年来,以大语言模型(LLM)为代表的深度学习技术为代码优化带来了新的可能性,但现有方法通常采用一步生成范式,难以捕捉复杂的优化方法。

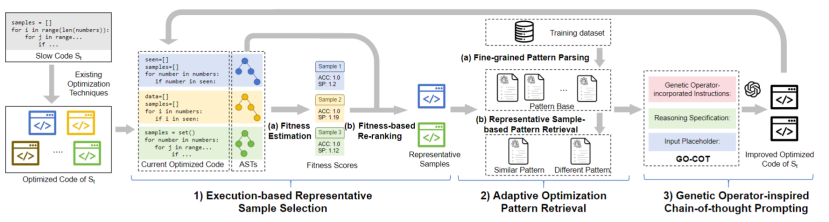

哈尔滨工业大学(深圳)高翠芸教授团队提出了一种基于搜索的大语言模型框架用于代码优化。该研究首次从搜索空间角度探索代码优化任务,并提出通过搜索方法增强大语言模型的能力,突破了传统一步生成范式的局限性。SBLLM框架将LLM与进化搜索算法协同整合,包含三个核心组件:基于执行的代表性样本选择机制,用于评估现有优化代码的适应度并优先选择有前景的代码;自适应优化模式检索机制,向模型注入针对性的优化模式,引导LLM逐步改进其优化方法;基于遗传算子的思维链提示方法,帮助LLM组合不同的优化方法并生成改进的优化代码。该框架遵循进化搜索范式,首先生成初始解决方案,然后迭代选择最适合的候选项,同时培育新的解决方案,直到满足终止条件。

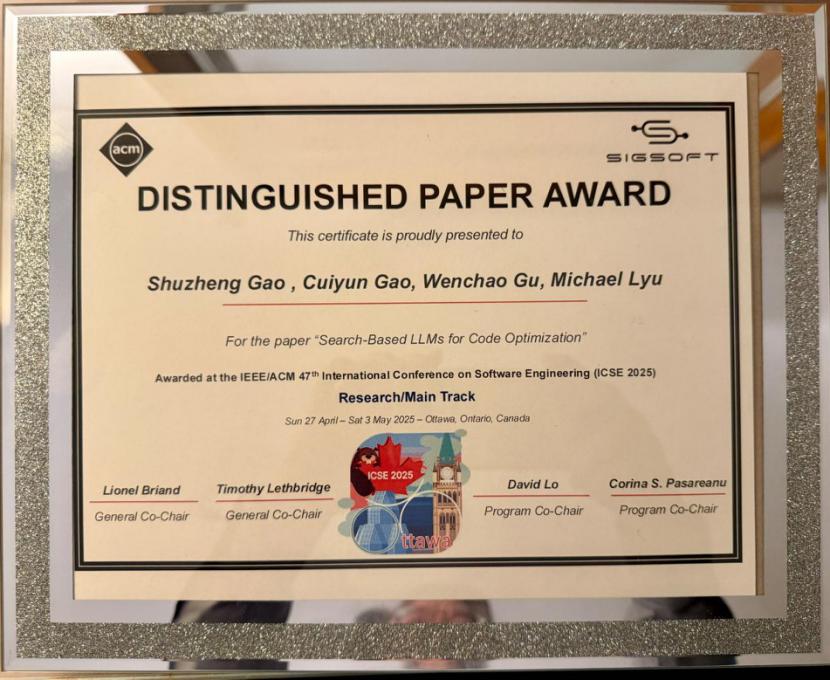

研究团队在包含Python和C++代码的基准数据集上进行了全面实验,评估了SBLLM与四种代表性基线方法在四种流行LLM上的表现,包括CodeLlama、Gemini、ChatGPT和GPT-4。实验结果表明,SBLLM能显著提高代码执行效率。具体而言,SBLLM可将程序执行效率提高高达209.59%,且在Python和C++的Top-5加速率指标上分别优于所有基线方法8.75%~28.06%和1.15%~9.56%。进一步的细粒度分析显示,SBLLM在生成正确代码方面表现卓越,在Python上达到最低的错误率,并在两种编程语言上均实现了超越人类编写参考代码的最高效率比率。该成果发表于软件工程领域顶级会议IEEE/ACM International Conference on Software Engineering 2025(ICSE’25,CCF-A类) 并获得ACM SIGSOFT Distinguished Paper Award(杰出论文奖)。

图1 基于搜索的大语言模型框架示意图

图2 ACM SIGSOFT Distinguished Paper Award

哈尔滨工业大学(深圳)高翠芸教授团队主要从事于软件分析、软件知识库挖掘、软件安全、代码自动化生成、元宇宙软件等,做有工业应用前景的工作。已在国际顶级会议和期刊(ICSE,ASE,FSE,TSE,WWW等)发表100+篇论文。荣获2025年CCF-A类会议ICSE杰出论文奖、2024年CCF-A类会议ICSE杰出论文奖、2024年CCF-A类会议ICSE企业竞赛通道最佳论文奖等多个奖项。(审核 高翠芸)